Os robôs estão a dominar o mundo! Esta é uma afirmação que, em anos anteriores, foi considerada uma coisa má - mas agora, pode não ser assim tão má.

Tens tido alguns discurso em torno da forma como os robôs, em particular a inteligência artificial, mudaram a nossa vida quotidiana e várias indústrias.

Quer se trate de simplificar a forma como realizamos as nossas tarefas ou de automatizar as tarefas de rotina no escritório, a IA tem vindo a afirmar-se como pioneira na inovação.

Um dos maiores contributos da IA é criação de conteúdos.

Os chatbots são construídos com modelos de processamento de linguagem natural (PNL) para responder a perguntas e simular respostas semelhantes às humanas.

Embora os chatbots possam ajudar com questões mundanas, podes querer verificar se o conteúdo escrito pelo chatbot é credível e autêntico para o fim a que se destina, como investigação académica ou jornalismo.

Nós tratamos de si.

Aqui estão as melhores formas de saber como verificar se algo foi escrito por um chatbot.

A solução rápida: Usa detectores de IA para identificar conteúdo escrito por chatbots

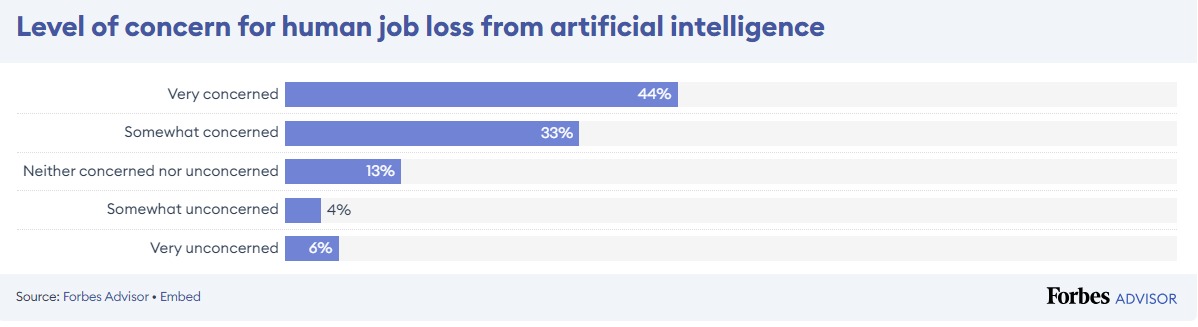

Prevê-se que a IA crie quase 100 milhões de empregos, facilitando as tarefas e permitindo que os aspirantes a trabalhadores explorem novas áreas.

As ferramentas de criação de conteúdos alimentadas por IA, por exemplo, podem produzir texto gerado por IA para tornar o processo mais rápido.

Mas com isto vem uma preocupação com a autenticidade. Onde é que isto se aplica?

Nunca mais se preocupe com o facto de a IA detetar os seus textos. Undetectable AI Pode ajudar-vos:

- Faça aparecer a sua escrita assistida por IA de tipo humano.

- Bypass todas as principais ferramentas de deteção de IA com apenas um clique.

- Utilização IA com segurança e com confiança na escola e no trabalho.

Pensa em apresentar um trabalho de investigação na aula. Um aluno apresenta um trabalho de investigação e o professor repara que o texto não parece estar correto.

Para verificar, o professor poderia utilizar um detetor de IA de confiança como IA indetetável para fazeres uma análise rápida e eficaz do trabalho do aluno.

Graças ao detetor de IA, o professor pode tomar uma decisão informada sobre a autenticidade dos trabalhos apresentados pelos seus alunos e tomar as medidas adequadas quando necessário.

Os detectores de IA analisam padrões linguísticos e estruturais que só podem ser gerados pela IA.

O conteúdo escrito pelo chatbot tem características específicas que o fazem sobressair perante o detetor, que analisa o conteúdo com mais pormenor do que aquilo que o olho nu consegue ver para garantir a sua precisão.

Os criadores de conteúdos também podem utilizar detectores de IA para verificar a originalidade do seu trabalho e localizar qualquer instância possível de plágio não intencional.

Por isso, embora a IA seja definitivamente valiosa para gerar ideias e inspiração para a escrita, é importante garantir que a utilização da IA se mantém ética e transparente.

Uma vez que cada vez mais instituições permitem a adoção da IATambém podes utilizar a IA indetetável para humanizar as ideias que recebes, para teres a certeza de que correspondem à qualidade da escrita humana.

É uma mistura saudável de utilização de IA para facilitar o processo de criação de conteúdos e, ao mesmo tempo, verificar que os conteúdos permanecem originais e continuam a ser feitos exclusivamente por ti.

Estás pronto para ver a diferença? Testa o widget Undetectable AI abaixo e experimenta em primeira mão como pode melhorar a tua escrita (apenas em inglês).

Basta introduzir o teu texto e ver como ele se transforma numa versão mais humanizada e polida. Experimenta agora!

Outros indicadores que te ajudam a identificar o conteúdo escrito pelo Chatbot

A IA tornou-se tão boa que, por vezes, confunde a fronteira entre o conteúdo humano e o gerado pela IA.

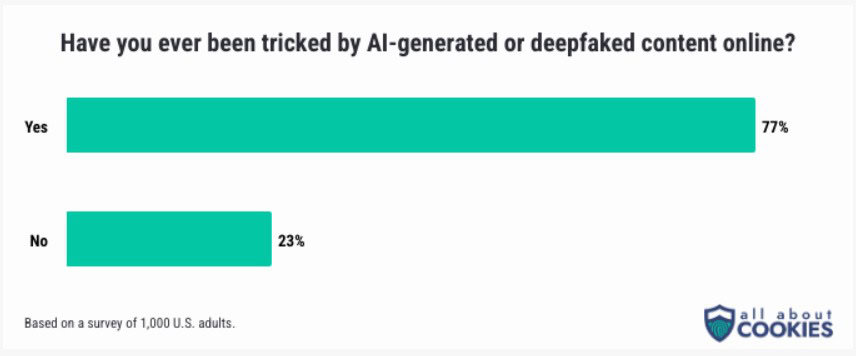

Mais do que sete em cada 10 pessoas admite ter sido enganado por conteúdos de IA de alguma forma. À medida que a IA evolui e se torna mais sofisticada, devem ser definidas políticas e directrizes éticas mais claras para a sua utilização adequada.

Embora os detectores de IA funcionem bem para identificar conteúdo escrito por chatbots, algumas características específicas podem ajudar-te a identificar manualmente se se trata de IA ou não.

1. Linguagem não natural

A linguagem não natural é um dos maiores sinais reveladores de como saber se algo foi escrito por IA.

O que queremos dizer com isto é que o texto é muito robótico e normalmente demasiado formal. Também não há um fluxo natural.

Alguns dos principais sinais de linguagem não natural incluem:

- Usa excessivamente palavras complexas e jargão técnico quando não é necessário.

- Falta de expressões informais e de escrita criativa.

- O texto não consegue manter um tom consistente e parece estar a ser remendado.

Um exemplo disso é quando um aluno decide confiar completamente no ChatGPT para criar o seu ensaio de admissão à faculdade.

Escreve uma mensagem, copia, cola e carrega em enviar. É fácil detetar o seu trabalho como IA devido à sofisticação excessiva da linguagem.

O nível de compreensão é muito superior ao de um estudante típico, o que levanta facilmente suspeitas de conteúdo gerado por IA.

A IA tende a ter uma linguagem não natural devido às limitações dos modelos de IA. Estes modelos limitam-se a replicar os padrões do discurso humano e tentam criar o seu próprio texto com base no que lhes é pedido.

2. Compreensão do contexto

Aqui tens algo frustrantemente relacionável: Pergunta a um chatbot de apoio ao cliente sobre um problema específico com o seu produto.

Em vez de responder diretamente à tua pergunta, o chatbot responde com algumas informações genéricas, como as políticas da empresa e os passos para utilizar o produto.

Não vais conseguir tirar mais proveito do chatbot, porque é tudo o que ele foi programado para fazer. Infelizmente, decidiste contactar o apoio humano, o que aumentou o tempo de espera.

É assim que é a falta de compreensão contextual. A compreensão contextual, como o nome indica, requer a capacidade de interpretar a informação dentro das circunstâncias relevantes.

O trabalho escrito humano tem isto porque fazemos a nossa pesquisa sobre um tópico quando escrevemos algo, fornecendo informações específicas e relevantes.

O conteúdo da IA pode muitas vezes parecer desarticulado e até sem sentido. Como apenas utiliza vários recursos a um nível superficial, a IA tem dificuldade em criar conteúdos que possam interpretar com precisão as nuances da linguagem.

3. Limitações do conhecimento

Embora a IA seja poderosa, não é um ser omnisciente. A IA não é imune a restrições, especialmente quando se trata de conhecimentos mais complexos.

Mas como a IA se destina a cumprir o que lhe é pedido, continua a preencher informações que não são verdadeiras ou mesmo inexistentes. E mesmo quando a IA pode fornecer dados correctos, estes estão normalmente desactualizados.

Eis algumas razões comuns pelas quais a IA tem limitações de conhecimento:

- Existe um enviesamento dos dados, o que significa que a IA só pode fornecer informações mais detalhadas sobre perspectivas bem representadas.

- Embora os modelos de IA sejam compostos por enormes conjuntos de dados, o âmbito do seu conhecimento não é infinito e tem de parar algures.

- Normalmente, a IA tem dificuldade em acompanhar as tendências e não dispõe das informações mais recentes.

Confiar apenas em conteúdos de IA pode ser alarmante porque pode espalhar desinformação.

Por exemplo, é muito provável que um artigo gerado por IA sobre procedimentos médicos avançados tenha imprecisões, o que pode ser prejudicial para fins de investigação.

4. Inconsistências no estilo de escrita

Já leste um artigo na Internet em que a introdução parecia muito interessante, mas depois as secções seguintes foram-se perdendo e parecia que tinha sido escrito por um autor completamente diferente?

O artigo que leste pode ter sido gerado por IA. O conteúdo da IA é famoso por ser inconsistente com o seu estilo de escrita.

É verdade que os modelos de IA são óptimos a imitar a linguagem humana. Mas falta-lhes a capacidade de se manterem consistentes em estilos de escrita distintos.

Vê aqui como são as inconsistências no estilo de escrita com a IA:

- O tom muda rapidamente de formal para informal ou de profissional para excessivamente casual dentro da mesma peça de conteúdo.

- O trabalho escrito por IA não consegue dar um fluxo coerente à escrita, parecendo bastante desconcertado.

- A legibilidade é difícil porque há demasiadas (ou falta de) perspectivas.

Estar ciente das inconsistências é importante para ter a certeza de que o conteúdo que estás a ler é credível ou não.

5. Padrões de erro

Errar é humano (e máquina). Mesmo os robots mais inteligentes que temos hoje em dia cometem erros.

Os padrões de erro são um sinal de alerta comum para os conteúdos gerados por IA, porque o próprio modelo de IA nem sempre funciona corretamente ou como pretendido e a organização não efectua um controlo de qualidade para verificar o texto e as informações fornecidas pela ferramenta.

Em suma, a IA foi utilizada para automatizar o processo de criação de conteúdos e, embora não seja má, pode correr mal se não for controlada.

Os erros podem ir desde erros gramaticais a erros ortográficos, afirmações contraditórias e até ideias que não fazem muito sentido lógico.

Porque é que isto acontece? A IA é apenas software com algoritmos complexos, o que abre a possibilidade de erros e falhas.

A qualidade dos dados utilizados para treinar os modelos de IA também pode influenciar o desempenho da ferramenta.

6. Verificação de factos ou dados pessoais

Outra coisa que a IA não faz bem é verificar as informações que fornece. A desinformação da IA é uma preocupação para mais de 75% dos consumidores.

A incapacidade da IA para verificar factos ou detalhes pessoais pode ser perigosa. A desinformação, em geral, pode levar a mal-entendidos e pode mesmo afetar indivíduos e organizações.

Estas são algumas formas de evitar ser mal informado pela IA:

- Nós, humanos, somos grandes verificadores, por isso verifica sempre as fontes fornecidas no conteúdo que lês.

- Exercita o espírito crítico e evita acreditar em tudo à primeira vista.

- Especialmente quando se trata de conteúdos de alto risco, certifica-te de que existe uma supervisão humana para verificar se o conteúdo é exato.

- Dedica algum tempo a conhecer os meandros da IA e a compreender as suas capacidades e limitações.

A IA tem dificuldade em conhecer dados exactos porque apenas se baseia na informação que lhe é fornecida. Isto significa que qualquer nova informação não está de todo disponível.

A IA também não efectua verificações cruzadas entre várias fontes nem tem a capacidade de validar a autenticidade da informação tão bem como os humanos.

Detecte conteúdos gerados por IA e humanize-os sem esforço - comece abaixo.

Conclusão

Com estes indicadores, podes ter mais confiança no conteúdo que lês.

A IA só vai melhorar, por isso é importante manteres-te atento à forma de verificar se algo foi escrito por um chatbot, porque as regras vão mudar e teremos de nos adaptar.

Consumimos tanto conteúdo online que pode facilmente parecer cansativo estar tão atento a tudo o que vemos. Para simplificar o processo, tem a Undetectable AI ao teu lado.

IA indetetável torna a deteção de IA fácil e eficiente, e podemos até melhorar a legibilidade do conteúdo que geras com o nosso humanizador de IA.

Para que possas estar à vontade com o conteúdo que tu próprio produzes. Duas ferramentas numa só plataforma.

Ao abraçarmos os benefícios da tecnologia de IA, vamos dar prioridade à sua utilização ética e combater a desinformação para manter a integridade da comunicação.