Er AI-innholdsdeteksjon alltid nøyaktig? Hvordan fungerer det egentlig? Dette er spørsmål som alle, fra studenter til bedriftseiere, bør ha svar på i 2026.

De siste fremskrittene innen kunstig intelligens har ført til at vi i dag kan skape utrolig realistisk AI-generert innhold som visker ut skillet mellom maskin og menneske.

Dette har åpnet for nye muligheter i ulike bransjer, men det innebærer også en stor utfordring når det gjelder å skille mellom menneskeskapt og AI-generert innhold.

Som et bransjeledende produkt har Undetectable AI bevist at maskinskrevet tekst faktisk kan være praktisk talt umulig å skille fra menneskelig prosa.

I denne guiden vil vi undersøke identifiseringsprosessen, utforske teknikker, detektorverktøy og fremtiden for innholdsautentisitet.

La oss dykke ned i det.

Det viktigste å ta med seg

- AI-deteksjon er probabilistisk snarere enn definitiv, noe som betyr at verktøyene beregner sannsynligheten for et maskinelt opphav basert på matematiske mønstre.

- Nøyaktighet er fortsatt et stort problem for bransjen, fordi falske positiver ofte flagger personer som ikke har engelsk som morsmål eller svært formelle menneskelige skribenter.

- Hybridstrategier er de mest effektive for å identifisere syntetisk tekst, og kombinerer automatisert programvare med menneskelig redaksjonell overvåking og faktasjekking.

- Våpenkappløpet mellom AI og deteksjon er konstant, ettersom generative modeller utvikler seg for å etterligne menneskelige “ufullkommenheter” mer effektivt for hver dag som går.

- Åpenhet er i ferd med å bli mer verdifullt enn kontroll, siden mange organisasjoner nå fokuserer på kvaliteten og nytten av innholdet i stedet for dets tekniske opprinnelse.

Hva er AI-innholdsdeteksjon og hvorfor er det viktig?

AI-innholdsdeteksjon er en prosess der man bruker spesialisert programvare til å analysere tekst og avgjøre om den er produsert av en stor språkmodell (LLM) som ChatGPT eller Claude.

Dette er viktig fordi det berører kjernen i digital tillit.

I utdanning bidrar det til å opprettholde akademisk integritet, i journalistikk sikrer det at rapporteringen er basert på menneskelig observasjon, og i søkemotoroptimalisering hjelper det plattformene med å identifisere søppelpost med lav innsats som kan skape rot på nettet.

Aldri bekymre deg for at AI oppdager tekstene dine igjen. Undetectable AI Kan hjelpe deg:

- Få AI-assistert skriving til å vises ...menneskelignende.

- Bypass alle de viktigste AI-deteksjonsverktøyene med bare ett klikk.

- Bruk AI trygt og selvsikkert i skole og arbeid.

På vei inn i 2026 har evnen til å identifisere syntetisk innhold blitt et spørsmål om sikkerhet.

Fra deepfake-artikler til automatiserte desinformasjonskampanjer - å vite hvor informasjonen kommer fra, er avgjørende for et velfungerende samfunn.

Deteksjonsverktøy fungerer som en første forsvarslinje, og hjelper brukerne med å verifisere at “stemmen” de lytter til, er støttet av menneskelig erfaring og ansvarlighet.

Hvordan AI-verktøy for innholdsdeteksjon faktisk fungerer

For å forstå hvordan en detektor flagger en setning, må du innse at disse verktøyene ikke “leser” etter mening slik en person gjør. I stedet utfører de en dyptgående statistisk analyse av tekstens struktur.

Mønstergjenkjenning og forutsigbarhet

AI-modeller er utformet for å forutsi det mest sannsynlige neste ordet i en sekvens. Dette fører til en høy grad av matematisk “glatthet” i teksten.

Detektorer ser etter denne mangelen på friksjon; hvis hvert ord er det statistisk sett mest sannsynlige valget, identifiserer verktøyet det som et maskingenerert mønster.

Perplexitet og burstiness forklart på en enkel måte

Perplexity måler hvor “overraskende” teksten er for en modell. Menneskers tekster har ofte høy perpleksitet fordi vi gjør uventede ordvalg.

Burstiness refererer til variasjonen i setningslengde og -struktur. Mennesker skriver i utbrudd - en lang, blomstrende setning etterfulgt av en kort, slagkraftig setning. AI har en tendens til å være veldig ensartet, noe som skaper en flat, rytmisk “summing” som detektorer raskt identifiserer.

Språkmodelleringssignaler

Detektorer bruker ofte en “speilversjon” av den kunstige intelligensen de prøver å fange.

Ved å kjøre en passasje gjennom en deteksjonsmodell kan programvaren se om teksten stemmer perfekt overens med sannsynlighetskartene til en generator. Hvis teksten følger nøyaktig den samme veien som en maskin ville tatt, utløser den en høy deteksjonsscore.

Maskinlæringsklassifikatorer bak deteksjon

De fleste moderne verktøy bruker “klassifikatorer” som har blitt trent opp på millioner av eksempler på både menneskelig og kunstig intelligens-tekst. Disse klassifikatorene lærer seg å oppdage de små, usynlige forskjellene i hvordan mennesker og maskiner bruker funksjonsord som “den”, “det” eller “er”.”

Over tid blir disse modellene svært følsomme for den subtile “stivheten” i syntetisk prosa.

Hvorfor deteksjonsresultater er sannsynligheter, ikke sikkerheter

Det er viktig å forstå at en AI-detektor ikke gir et “ja” eller “nei”-svar. I stedet gir den en sannsynlighetsscore, for eksempel “85% er sannsynligvis AI”.”

Fordi menneskelig skriving noen ganger kan være forutsigbar og formell, mens AI-skriving kan være kaotisk, kan disse verktøyene bare gi en kvalifisert gjetning basert på aktuelle data.

Vanlige tegn på AI-generert innhold

Selv om programvare er nyttig, kan det menneskelige øyet ofte oppdage “avslørende” tegn på maskinell opprinnelse hvis du vet hva du skal se etter.

- Overdrevent polert, men generisk språk: AI skriver ofte på en måte som er grammatisk perfekt, men som er fullstendig blottet for personlighet eller unik “smak”.”

- Repeterende setningsstrukturer: Maskiner starter ofte flere setninger på rad med samme ord eller bruker nøyaktig samme lengde på alle setningene i et avsnitt.

- Mangel på personlig erfaring eller spesifikke detaljer: En AI kan beskrive et konsept, men den kan ikke dele en spesifikk anekdote om en feil den har gjort, eller en unik sanselig detalj fra en virkelig hendelse.

- Forutsigbar flyt i avsnittene: AI-generert innhold følger vanligvis et veldig strengt “Innledning, punkt A, punkt B, punkt C, konklusjon”-format uten den organiske vandringen i den menneskelige tanken.

- Vage overganger og sikre konklusjoner: Se etter setninger som “Avslutningsvis”, “Det er viktig å merke seg” eller “Videre”, som brukes på en mekanisk måte som ikke tilfører fortellingen noen reell verdi.

De mest populære AI-verktøyene for innholdsdeteksjon i dag

Flere verktøy har vokst frem som de ledende på området, og hvert av dem tilbyr ulike styrker for ulike typer brukere.

Ikke påvisbar AI

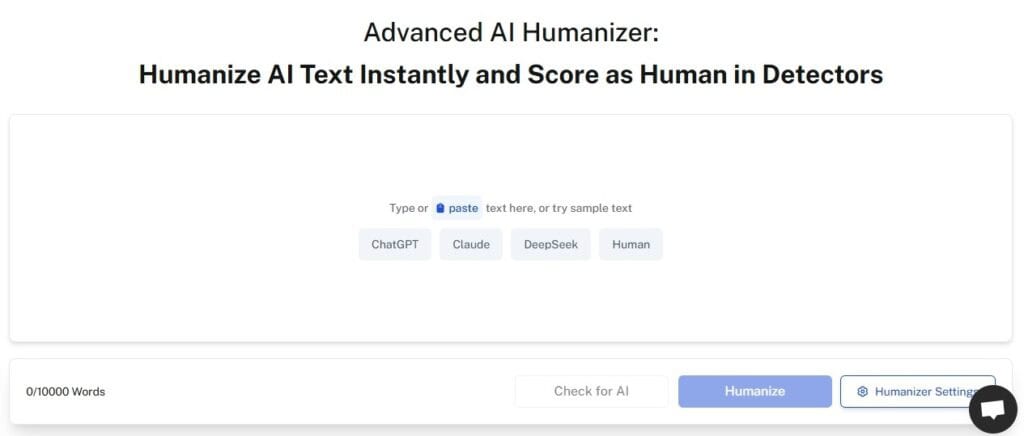

Ikke påvisbar AI er unik fordi den tilbyr en multimodelltilnærming. I stedet for å basere seg på én enkelt algoritme, kombinerer den gratis detektoren logikken til mer enn sju ulike deteksjonsmodeller i ett enkelt grensesnitt.

Dette gir brukerne en mer “bred” oversikt over hvordan teksten deres kan bli oppfattet av ulike systemer på nettet.

Turnitin AI-deteksjon

Svingitin er den dominerende kraften i den akademiske verden. Verktøyet er spesielt tilpasset for å finne AI i studentoppgaver og forskningsartikler.

Det er mye brukt av universiteter over hele verden, selv om det har fått kritikk for at det av og til flagger originalt menneskelig arbeid som maskingenerert.

GPTZero

GPTZero ble opprinnelig utviklet som et doktorgradsprosjekt ved Princeton, og var et av de første verktøyene som ble populære. Den er kjent for sine “Perplexity”- og “Burstiness”-poengsummer, som hjelper brukerne med å se de nøyaktige matematiske årsakene til at et stykke tekst føles “robotaktig”.”

Copyleaks

Copyleaks er foretrukket av bedrifter og virksomheter på grunn av sin høye nøyaktighet og evne til å oppdage “parafraserte” plagiater. Den er spesielt effektiv til å identifisere når noen har tatt AI-tekst og gjort mindre manuelle endringer for å prøve å skjule den.

Originalitet.ai

Dette verktøyet markedsføres først og fremst mot nettutgivere og SEO-profesjonelle. Det er designet for å være svært sensitivt, og flagger ofte selv små mengder AI-assistanse. Det er en favoritt for dem som trenger å sikre at innholdet de kjøper fra frilansere, er 100% skrevet av mennesker.

Nøyaktighetsproblemet: Kan man stole på AI-innhold?

Det mest kontroversielle aspektet ved bransjen er spørsmålet om pålitelighet. Selv om deteksjonsverktøyene blir stadig bedre, er de langt fra perfekte, og feil i dem kan få konsekvenser i den virkelige verden.

Falske positiver på menneskelig skrift

En “falsk positiv” oppstår når et verktøy feilaktig identifiserer menneskelig skrift som AI. Dette skjer ofte i forbindelse med svært strukturerte tekster, som juridiske dokumenter, vitenskapelige rapporter eller til og med Bibelen. Dette har ført til mange tilfeller der studenter urettmessig har blitt anklaget for fusk.

Falske negativer på AI-innhold

En “falsk negativ” oppstår når AI-generert tekst fremstår som menneskelig.

Med verktøy som Undetectable AIs AI Humanizer, er det nå mulig å omskrive maskintekst slik at den etterligner kompleksiteten og tilfeldigheten i menneskelig prosa, noe som effektivt omgår nesten alle dagens detektorer.

Fordommer mot forfattere som ikke har engelsk som morsmål

Forskning har vist at AI-detektorer er mer tilbøyelige til å flagge skriften til personer som ikke har engelsk som morsmål.

Fordi disse skribentene ofte bruker et mer formelt og mindre variert vokabular, vil arbeidet deres naturlig nok gjenspeile de statistiske mønstrene som detektorene ser etter, noe som fører til urettferdige skjevheter i akademiske og profesjonelle miljøer.

Hvem bruker AI-innholdsdeteksjon (og hvorfor)

Bruken av disse verktøyene er utbredt, men motivasjonen varierer fra bransje til bransje.

| Brukergruppe | Hovedmål | Hvorfor resultatene ofte varierer |

| Utdanningsinstitusjoner | Forebygge akademisk uredelighet og fusk. | Akademisk skriving er naturlig nok formell, noe som forvirrer mange grunnleggende detektorer. |

| Team for innholdsmarkedsføring | Sørg for at innholdet er “nyttig” og rangerer godt i søk. | Ulike verktøy prioriterer ulike SEO-signaler og søkeordtettheter. |

| Forleggere og medier | Oppretthold merkevarens autoritet og menneskelige stemme. | Journalistikk bruker ofte korte, slagkraftige setninger som kan se ut som “low burstiness” for AI. |

| Rekrutterere | Filtrer ut masseproduserte, AI-skrivne følgebrev. | Profesjonelle CV-er bruker standardiserte maler som maskiner etterligner perfekt. |

Hvordan uoppdagelig AI bidrar til å forbedre menneskeliknende skriving

Deteksjon er den ene siden av mynten, mens den andre er “menneskeliggjøring”. Undetectable AI tilbyr en rekke verktøy som hjelper skribenter med å bruke AI på en ansvarlig måte, samtidig som de sikrer at det endelige resultatet føles autentisk.

Reduksjon av forutsigbare AI-mønstre

Programvaren analyserer utkastet ditt og identifiserer de “maskinlignende” sekvensene som normalt ville utløst et flagg. Deretter omorganiserer og omformulerer den disse delene på en intelligent måte for å skape en mer naturlig flyt.

Forbedre naturlig flyt og stemme

Ved å bruke AI Humanizer, kan skribenter tilføre den “sprøheten” og språklige variasjonen som maskiner vanligvis mangler. Resultatet er en tekst som ikke bare er “umulig å oppdage”, men som også er mer engasjerende for den menneskelige leser.

Forfining av tone og setningsvariasjon

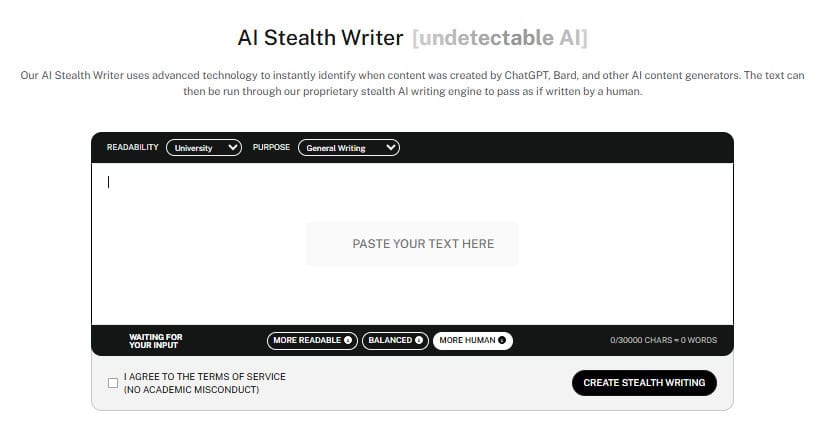

Våre AI Stealth Writer lar brukerne velge mellom ulike “menneskelige” nivåer, fra videregående nivå til universitets- eller profesjonsnivå.

Dette sikrer at tonen forblir konsistent med målgruppen, og forhindrer “tonal whiplash” som oppstår når rå AI prøver å høres for smart ut.

Støtte til ansvarlig bruk av AI

Målet er ikke å lure, men å forbedre. Ved å tilby en AI-innholdsdetektor Ved siden av humaniseringsverktøyene oppfordrer Undetectable AI skribenter til å kontrollere arbeidet sitt, oppgi kilder og sørge for at den endelige innsendingen gjenspeiler deres egne ideer og redigering.

Fremtiden for AI-innholdsdeteksjon

Når vi ser mot 2027 og fremover, vil kampen mellom generasjon og deteksjon fortsette å omforme hvordan vi samhandler med informasjon på nettet.

- Det pågående våpenkappløpet mellom kunstig intelligens og deteksjon: Hver gang en detektor blir smartere, blir generatorene bedre til å etterligne menneskelig “støy”. Denne syklusen vil sannsynligvis fortsette helt til vi når et punkt med “perfekt paritet”.”

- Smartere deteksjonsalgoritmer: Fremtidige verktøy vil sannsynligvis se på “metadata” og “fingeravtrykksteknikker”, for eksempel skjulte vannmerker som er lagt inn av selskapene som lager AI-modellene.

- Skiftet mot åpenhet i stedet for politiarbeid: Mange eksperter mener at vi etter hvert vil slutte å prøve å “fange” AI og i stedet fokusere på verifiserbare “human-in-the-loop”-arbeidsflyter.

- Hvorfor skriveferdigheter fortsatt er viktige: Selv i en verden full av kunstig intelligens er evnen til å redigere, faktasjekke og gi et unikt menneskelig perspektiv fortsatt den mest verdifulle egenskapen en skribent kan ha.

Prøv vår AI Detector og Humanizer i widgeten nedenfor!

Ofte stilte spørsmål

Er AI-innholdsdeteksjon alltid nøyaktig?

Nei, den er sannsynlighetsbasert. Falske positive resultater er vanlige, særlig når det gjelder formelle tekster eller tekster som ikke er skrevet på morsmålsengelsk. Du bør alltid bruke deteksjonsresultatene som et utgangspunkt for undersøkelser, og ikke som en endelig dom.

Kan Google straffe meg for AI-generert innhold?

Ifølge Googles søkesentral, Google fokuserer på kvaliteten og nytten av innholdet. Hvis AI-innholdet ditt ikke er nyttig eller er laget utelukkende for å manipulere rangeringer, vil det bli straffet, uavhengig av om det er skrevet av en maskin.

Hvordan gjør jeg AI-innholdet mitt umulig å oppdage?

Den mest effektive måten er å bruke et humaniseringsverktøy som Undetectable AI, som restrukturerer teksten slik at den samsvarer med menneskelige språkmønstre. De beste resultatene får du imidlertid alltid ved å legge til dine egne personlige historier og unike innsikter manuelt.

Fanger Turnitin opp alt AI-innhold?

Turnitin er svært avansert, men kan likevel omgås ved hjelp av sofistikert omskriving og humanisering. Den brukes best av lærere for å se etter generelle mønstre av inkonsekvens i en elevs arbeid over tid.

Konklusjon

Etter hvert som kunstig intelligens blir en fast bestanddel av våre kreative og profesjonelle liv, er det viktig å forstå hvordan ai-innhold oppdages for å opprettholde integritet og tillit.

Selv om deteksjonsverktøyene gir et verdifullt innblikk i en teksts matematiske opphav, er de ikke ufeilbarlige dommere.

De som lykkes best i 2026, er de som bruker disse verktøyene på en ansvarlig måte og kombinerer effektiviteten til kunstig intelligens med den uerstattelige varmen og nyansene til en menneskelig stemme.

Ved å holde deg informert og bruke en flerlagstilnærming til verifisering kan du navigere trygt på det moderne nettet.

Autentisitet er den mest verdifulle valutaen i automatiseringens tidsalder. Sørg for at stemmen din blir hørt, ikke bare instruksjonene dine.

Er du klar til å sikre at det du skriver er både av høy kvalitet og autentisk deg? Utforsk Ikke påvisbar AI for å menneskeliggjøre utkastene dine og opprettholde det profesjonelle overtaket.