机器人正在占领世界 现在,这种说法在过去几年被认为是一件坏事--但现在,它实际上可能并不那么糟糕。

有一些 论述 围绕机器人(尤其是人工智能)如何改变我们的日常生活和各行各业。

无论是简化我们完成家务的方式,还是实现办公室日常工作的自动化,人工智能无疑已成为创新领域的领跑者。

人工智能的最大贡献之一是 内容创作.

聊天机器人采用自然语言处理(NLP)模型来回答询问和模拟类似人类的回答。

虽然聊天机器人可以帮助您解决普通的询问,但您可能需要检查聊天机器人编写的内容,以确保您阅读的内容是可信的、真实的,符合其预期目的,如学术研究或新闻报道。

我们为您提供服务。

以下是了解如何检查内容是否由聊天机器人撰写的最佳方法。

快速解决方案:使用人工智能检测器识别聊天机器人编写的内容

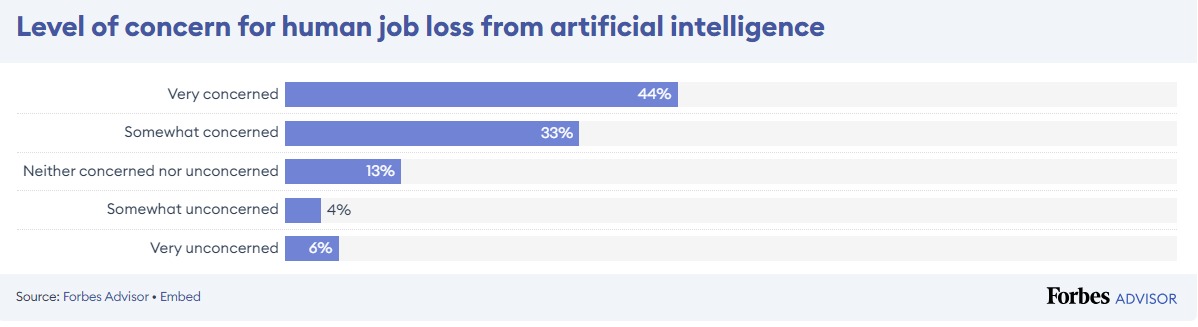

预计人工智能将创造近 1 亿个工作岗位这使任务变得更容易,同时也让有抱负的工人能够探索新的领域。

例如,人工智能驱动的内容创建工具可以生成人工智能生成的文本,使流程更快。

但随之而来的是对真实性的担忧。这适用于哪些方面?

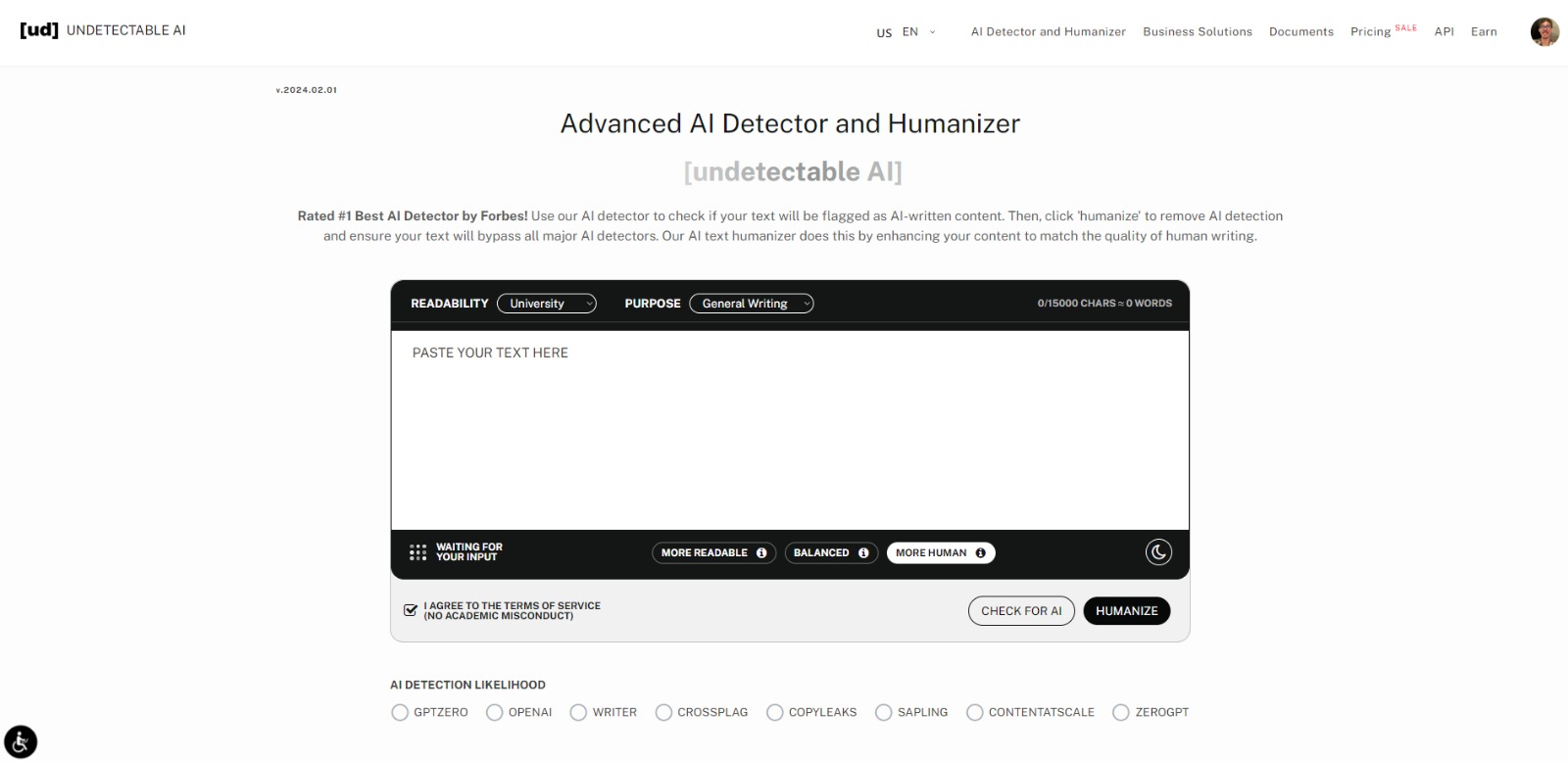

再也不用担心人工智能检测到你的短信了 Undetectable AI 可以帮助您:

- 让人工智能辅助写作显现出来 像人一样

- 旁路 只需点击一下,就能使用所有主要的人工智能检测工具。

- 使用 人工智能 安全地 和 自信地 在学校和工作中。

想想在课堂上提交研究论文。一名学生提交了一篇论文,老师注意到文章似乎有些偏差。

为了验证 教师 可以使用可信的人工智能检测器,如 检测不到的人工智能 对学生的作业进行快速有效的分析。

有了人工智能检测器,教师就能对学生提交的论文的真实性做出明智的判断,并在必要时采取适当的措施。

人工智能检测器分析只能由人工智能生成的语言和结构模式。

聊天机器人撰写的内容具有特定的特征,使其在检测器面前脱颖而出,检测器会比肉眼看到的内容更详细地审查内容的准确性。

内容创作者还可以使用人工智能检测器来验证其作品的原创性,并追踪任何可能存在的剽窃行为。 无意抄袭.

因此,虽然人工智能对于产生写作想法和灵感绝对有价值,但重要的是要确保人工智能的使用保持道德和透明。

由于现在越来越多的机构允许 采用人工智能此外,您还可以使用 "无法检测的人工智能"(Undetectable AI)对您获得的想法进行人性化处理,以确保它们符合人类写作的质量。

既要利用人工智能简化内容创作流程,又要确保内容的原创性和独特性。

准备好看到不同之处了吗?测试下面的 "无法察觉的人工智能 "小工具,亲身体验它如何提高您的写作水平(仅限英文)。

只需输入文字,就能看到它变成更人性化、更精致的版本。现在就试试吧!

有助于识别聊天机器人编写内容的其他指标

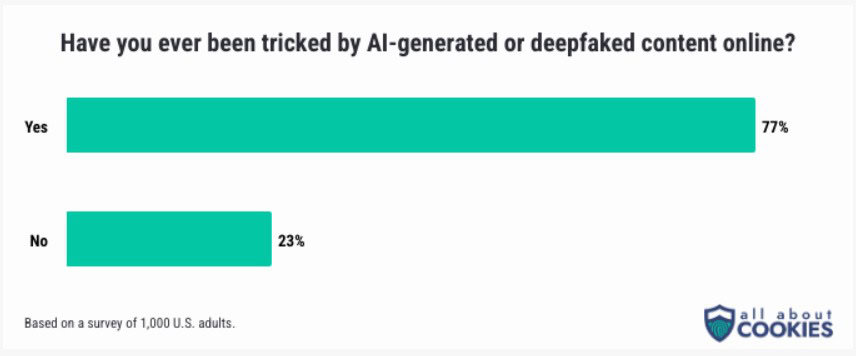

人工智能已经变得如此出色,以至于有时会模糊人类和人工智能生成的内容之间的界限。

超过 十分之七 承认以某种形式受到人工智能内容的欺骗。随着人工智能的发展和日益成熟,应该为其正确使用制定更明确的政策和道德准则。

虽然人工智能检测器能很好地识别聊天机器人编写的内容,但一些特定的特征也能帮你手动识别是否是人工智能。

1.非自然语言

不自然的语言是最大的 "蛛丝马迹 "之一,它能让人一眼就看出某篇文章是否是人工智能写的。

我们的意思是,文字非常机械,通常过于正式。也缺乏自然流畅。

语言不自然的主要表现包括

- 不必要时过度使用复杂词汇和专业术语。

- 缺乏随意的表达和创造性的写作。

- 文字无法保持一致的基调,给人一种东拼西凑的感觉。

例如,当学生决定完全依赖 ChatGPT 来创建他们的 大学入学论文.

他们输入提示,复制、粘贴,然后按发送键。由于语言过于复杂,很容易发现他们的工作是人工智能。

其理解水平远远超出了一般学生的理解能力,很容易让人怀疑内容是人工智能生成的。

由于人工智能模型的局限性,人工智能的语言往往不自然。这些模型只是复制人类的语言模式,并试图根据提示创建自己的文本。

2.语境理解

这里有一件令人沮丧的事:向客服聊天机器人询问产品的具体问题。

聊天机器人不会直接回答您的问题,而是回复一些通用信息,如公司政策和产品使用步骤。

您将无法从聊天机器人那里获得更多信息,因为这就是聊天机器人的全部功能。令人失望的是,您决定联系人工支持,这增加了等待时间。

这就是缺乏语境理解的表现。语境理解,顾名思义,需要在相关环境中解读信息的能力。

人类的书面作品就有这样的特点,因为我们在写作时会对某个主题进行研究,提供具体的相关信息。

人工智能的内容有时会让人感觉杂乱无章,甚至毫无道理。因为人工智能只是从表面上挖掘各种资源,所以它很难创造出能够准确解读语言细微差别的内容。

3.知识局限

人工智能虽然强大,但并非无所不知。人工智能也难免受到制约,尤其是在涉及到更复杂的知识时。

但是,由于人工智能的目的是完成提示它要做的事情,它仍然会填写不真实甚至不存在的信息。即使人工智能能提供正确的数据,通常也是过时的。

以下是人工智能存在知识局限性的常见原因:

- 数据存在偏差,这意味着人工智能只能从代表性强的角度提供更详细的信息。

- 虽然人工智能模型是由庞大的数据集组成的,但其知识范围并不是无限的,必须止步于某个地方。

- 人工智能通常难以跟上潮流,缺乏最新信息。

仅仅依靠人工智能内容可能会令人担忧,因为它可能会 造谣.

例如,人工智能生成的关于高级医疗程序的文章最有可能存在不准确之处,这对研究目的可能是有害的。

4.写作风格不一致

你是否在网上读过这样一篇文章:导言看起来非常吸引人,但接下来的部分却显得乏善可陈,感觉像是完全不同的作者写出来的?

你读到的那篇文章可能只是人工智能生成的。人工智能内容的写作风格不一致是出了名的。

人工智能模型的确擅长模仿人类语言。但它们严重缺乏在不同写作风格中保持一致的能力。

以下是人工智能写作风格不一致的通常表现:

- 在同一篇内容中,语气很快就会从正式转为非正式,或从专业转为过于随意。

- 人工智能编写的作品无法提供连贯的行文流畅,看起来相当错乱。

- 可读性难,是因为视角太多(或缺乏视角)。

要确定你所阅读的内容是否可信,意识到这些不一致之处非常重要。

5.错误模式

人(和机器)都会犯错。 即使是当今最聪明的机器人也会犯错。

错误模式是人工智能生成内容的常见红旗,因为人工智能模型本身并不总能正常工作或达到预期效果,而且组织没有进行质量检查来验证工具提供的文本和信息。

简而言之,人工智能被用来实现内容生成过程的自动化,虽然这并不是坏事,但如果不加以控制,也会出错。

这些错误可能包括语法错误、拼写错误、自相矛盾的陈述,甚至是没有太多逻辑意义的观点。

为什么会出现这种情况?人工智能只是一个具有复杂算法的软件,这就为出现错误和故障提供了可能性。

用于训练人工智能模型的数据质量也会影响工具的性能。

6.核实事实或个人信息

人工智能做得不好的另一件事是验证它提供的信息。人工智能提供的错误信息是一个令人担忧的问题。 消费者的 75%.

人工智能无法核实事实或个人细节可能是危险的。一般来说,错误信息会导致误解,甚至会影响个人和组织。

以上是避免被人工智能误导的几种方法:

- 我们人类是很好的交叉检查者,所以一定要检查所读内容中提供的来源。

- 锻炼批判性思维能力,避免乍一看什么都信。

- 尤其是涉及到高风险内容时,要确保有人工监督,以确保内容的准确性。

- 花时间学习人工智能的复杂性,了解其能力和局限性。

人工智能很难了解准确的数据,因为它只能依赖于所获得的信息。这就意味着,任何新信息都是不可用的。

人工智能也无法像人类一样对多个信息源进行交叉核对,或验证信息的真实性。

检测人工智能生成的内容,并毫不费力地将其人性化--下面就开始吧。

结论

有了这些指标,您就可以对阅读的内容更有信心了。

人工智能只会发展得越来越好,所以我们必须密切关注如何检查某篇文章是否由聊天机器人撰写,因为规则会改变,我们必须适应。

我们在网上消费了太多内容,以至于无论看到什么都要如此专注,很容易让人感觉疲惫。为了简化这一过程,Undetectable AI 将与您并肩作战。

检测不到的人工智能 让人工智能检测变得简单而高效,我们甚至还能通过人工智能人性化器提高您生成的内容的可读性。

因此,您可以放心使用自己制作的内容。一个平台两种工具。

在我们拥抱人工智能技术带来的好处时,让我们优先考虑其道德使用,并打击错误信息,以保持沟通的完整性。