I robot stanno conquistando il mondo! Si tratta di un'affermazione che negli anni passati era considerata negativa, ma che ora potrebbe non essere così negativa.

Ci sono stati alcuni discorso che riguardano il modo in cui i robot, in particolare l'intelligenza artificiale, hanno cambiato la nostra vita quotidiana e diversi settori industriali.

Che si tratti di semplificare il modo in cui sbrighiamo le faccende domestiche o di automatizzare le attività di routine in ufficio, l'intelligenza artificiale si è decisamente affermata come leader nell'innovazione.

Uno dei maggiori contributi dell'IA è creazione di contenuti.

I chatbot sono costruiti con modelli di elaborazione del linguaggio naturale (NLP) per rispondere alle domande e simulare risposte simili a quelle umane.

Sebbene i chatbot possano aiutare a rispondere a domande banali, potresti voler controllare i contenuti scritti dai chatbot per assicurarti che ciò che leggi sia credibile e autentico per il suo scopo, come una ricerca accademica o giornalistica.

Abbiamo pensato a voi.

Ecco i modi migliori per sapere come verificare se qualcosa è stato scritto da un chatbot.

La soluzione rapida: Usa i rilevatori di intelligenza artificiale per identificare i contenuti scritti dai chatbot

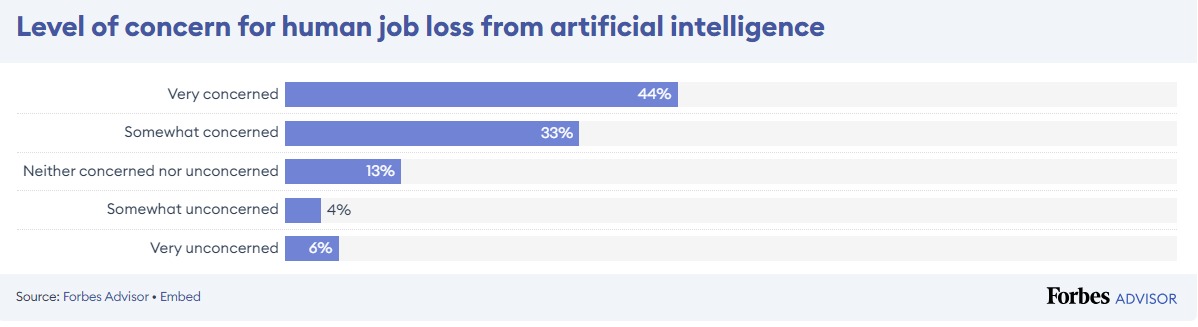

Si prevede che l'intelligenza artificiale creerà quasi 100 milioni di posti di lavororendendo i compiti più semplici e consentendo agli aspiranti lavoratori di esplorare nuove aree.

Gli strumenti di creazione di contenuti basati sull'AI, ad esempio, possono produrre testo generato dall'AI per rendere il processo più veloce.

Ma a questo si aggiunge la preoccupazione per l'autenticità. Dove si applica?

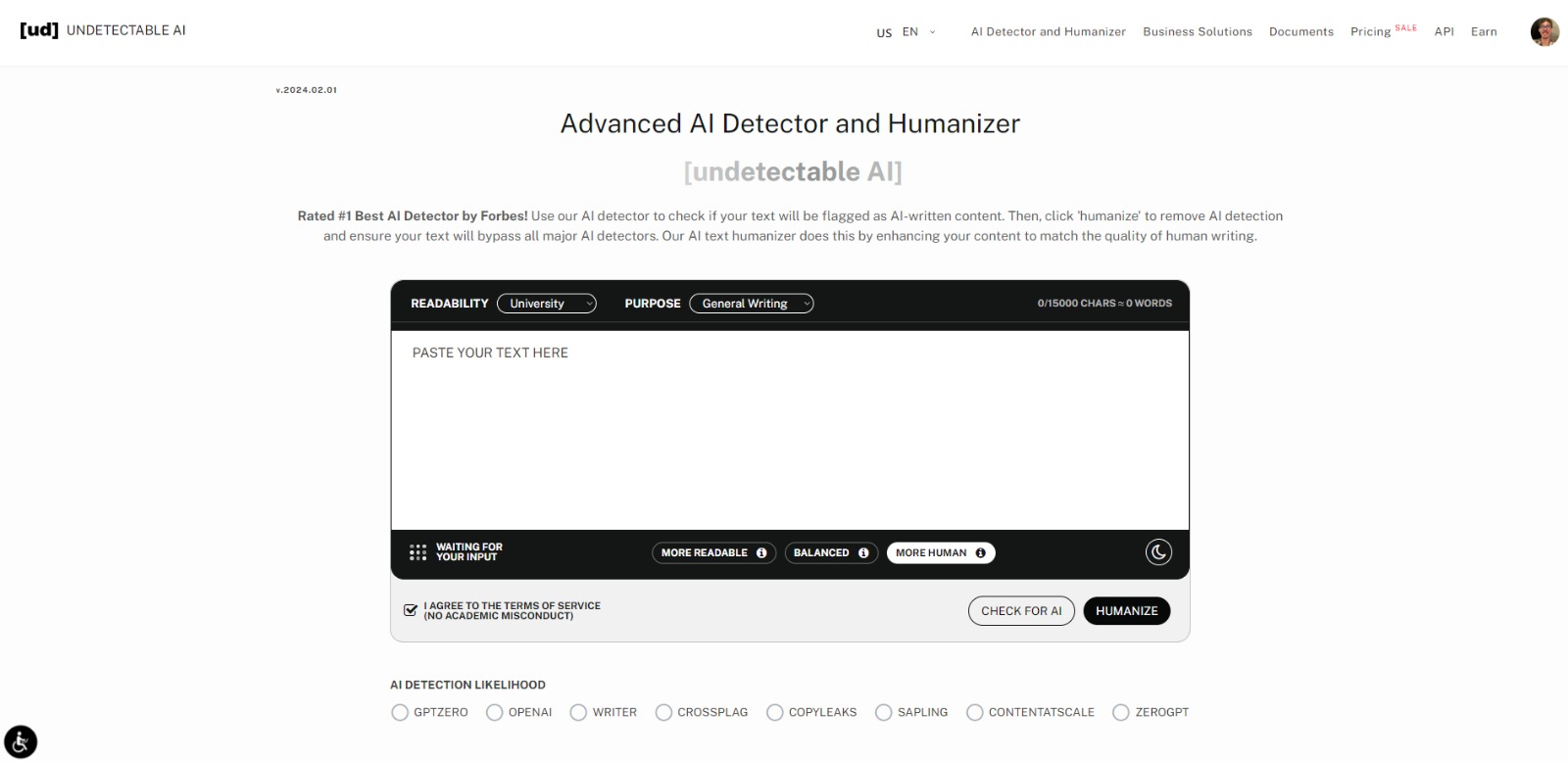

Non preoccupatevi più che l'intelligenza artificiale rilevi i vostri messaggi. Undetectable AI Può aiutarvi:

- Fate apparire la vostra scrittura assistita dall'intelligenza artificiale simile all'uomo.

- Bypass tutti i principali strumenti di rilevamento dell'intelligenza artificiale con un solo clic.

- Utilizzo AI in modo sicuro e con fiducia a scuola e al lavoro.

Pensa alla presentazione di un lavoro di ricerca in classe. Uno studente ne presenta uno e l'insegnante nota che il testo non sembra corretto.

Per verificare, il insegnante potrebbe utilizzare un rilevatore di IA affidabile come AI non rilevabile per fare un'analisi rapida ed efficace del lavoro dello studente.

Grazie al rilevatore di intelligenza artificiale, l'insegnante può decidere con cognizione di causa l'autenticità degli elaborati presentati dai suoi studenti e prendere i provvedimenti del caso quando necessario.

I rilevatori di intelligenza artificiale analizzano i modelli linguistici e strutturali che possono essere generati solo dall'intelligenza artificiale.

I contenuti scritti dai chatbot hanno caratteristiche specifiche che li fanno notare al rilevatore, che esamina i contenuti in modo più dettagliato di quanto possa vedere l'occhio nudo per verificarne l'accuratezza.

I creatori di contenuti possono anche utilizzare i rilevatori di AI per verificare l'originalità del loro lavoro e rintracciare ogni possibile istanza di plagio involontario.

Quindi, se da un lato l'intelligenza artificiale è sicuramente preziosa per generare idee e ispirazione per la scrittura, dall'altro è importante assicurarsi che l'uso dell'intelligenza artificiale rimanga etico e trasparente.

Sempre più istituzioni consentono l'uso di adozione dell'IAPuoi anche utilizzare Undetectable AI per umanizzare le idee che ricevi per essere sicuro che corrispondano alla qualità della scrittura umana.

Si tratta di un mix sano di utilizzo dell'intelligenza artificiale per facilitare il processo di creazione dei contenuti, controllando allo stesso tempo che i contenuti rimangano originali e che siano realizzati in modo unico da te.

Sei pronto a vedere la differenza? Prova il widget Undetectable AI qui sotto e sperimenta in prima persona come può migliorare la tua scrittura (solo in inglese).

Inserisci il tuo testo e guarda come si trasforma in una versione più umana e curata. Provalo subito!

Altri indicatori che aiutano a identificare i contenuti scritti dai chatbot

L'Intelligenza Artificiale è diventata così brava che a volte confonde il confine tra i contenuti generati dall'uomo e quelli generati dall'Intelligenza Artificiale.

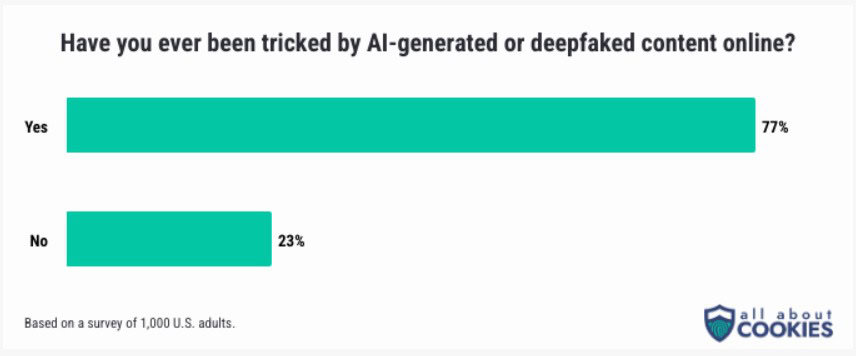

Più di sette individui su dieci ammettono di essere stati ingannati dai contenuti dell'IA in qualche modo. Man mano che l'IA si evolve e diventa più sofisticata, dovrebbero essere definite politiche più chiare e linee guida etiche per il suo corretto utilizzo.

Fonte = All About Cookies

Sebbene i rilevatori di AI funzionino bene per identificare i contenuti scritti dai chatbot, alcune caratteristiche specifiche possono aiutarti a identificare manualmente se si tratta di AI o meno.

1. Linguaggio innaturale

Il linguaggio innaturale è uno dei maggiori segni rivelatori per capire se qualcosa è stato scritto da un'intelligenza artificiale.

In altre parole, il testo è molto robotico e di solito eccessivamente formale. Manca anche un flusso naturale.

Alcuni dei principali segnali di un linguaggio innaturale sono:

- Uso eccessivo di parole complesse e gergo tecnico quando non è necessario.

- Mancanza di espressioni disinvolte e di scrittura creativa.

- Il testo non riesce a mantenere un tono coerente e si sente come se fosse rabberciato.

Un esempio è quello in cui uno studente decide di affidarsi completamente a ChatGPT per creare il suo Saggio di ammissione all'università.

Digitano un messaggio, copiano, incollano e premono invio. È facile riconoscere il loro lavoro come IA a causa dell'eccessiva sofisticazione del linguaggio.

Il livello di comprensione è di gran lunga superiore a quello di uno studente normale, il che fa facilmente sospettare che si tratti di contenuti generati dall'intelligenza artificiale.

L'IA tende ad avere un linguaggio innaturale a causa dei limiti dei modelli di IA. Questi modelli replicano semplicemente i modelli di linguaggio umano e cercano di creare il proprio testo in base a ciò che viene richiesto.

2. Comprensione del contesto

Ecco qualcosa di frustrante da raccontare: Chiedi a un chatbot del servizio clienti un problema specifico con il loro prodotto.

Invece di rispondere direttamente alla domanda dell'utente, il chatbot risponde con alcune informazioni generiche, come le politiche aziendali e i passaggi per utilizzare il prodotto.

Non potrai ottenere di più dal chatbot perché è stato programmato solo per questo. Purtroppo hai deciso di contattare l'assistenza umana, il che ha aumentato il tempo di attesa.

Ecco come si presenta la mancanza di comprensione contestuale. La comprensione contestuale, come dice il nome, richiede la capacità di interpretare le informazioni all'interno delle circostanze pertinenti.

Il lavoro scritto umano ha questo aspetto perché quando scriviamo facciamo ricerche su un argomento, fornendo informazioni specifiche e pertinenti.

I contenuti dell'IA possono spesso risultare disarticolati e persino privi di senso. Poiché si limita a sfruttare varie risorse a livello superficiale, l'intelligenza artificiale fatica a creare contenuti in grado di interpretare accuratamente le sfumature del linguaggio.

3. Limitazioni della conoscenza

Sebbene l'intelligenza artificiale sia potente, non è un essere onnisciente. L'intelligenza artificiale non è immune da vincoli, soprattutto quando si tratta di conoscenze più complesse.

Ma poiché l'intelligenza artificiale è destinata a soddisfare ciò che le viene chiesto di fare, inserirà comunque informazioni non veritiere o addirittura inesistenti. E anche quando l'intelligenza artificiale è in grado di fornire dati corretti, di solito sono obsoleti.

Ecco i motivi più comuni per cui l'intelligenza artificiale ha dei limiti di conoscenza:

- C'è una distorsione dei dati, il che significa che l'intelligenza artificiale può fornire informazioni più dettagliate solo su prospettive ben rappresentate.

- Sebbene i modelli di IA siano composti da enormi set di dati, la portata della loro conoscenza non è infinita e deve fermarsi da qualche parte.

- L'intelligenza artificiale di solito fatica a stare al passo con le tendenze e non dispone di informazioni aggiornate.

Affidarsi esclusivamente ai contenuti dell'intelligenza artificiale può essere allarmante perché può diffondere disinformazione.

Ad esempio, un articolo generato dall'intelligenza artificiale su procedure mediche avanzate è molto probabile che presenti delle imprecisioni, che possono essere dannose ai fini della ricerca.

4. Incoerenze nello stile di scrittura

Ti è mai capitato di leggere un articolo online in cui l'introduzione sembrava davvero accattivante, ma poi le sezioni successive si sono afflosciate e sembrava che l'avesse scritto un autore completamente diverso?

L'articolo che hai letto potrebbe essere generato dall'intelligenza artificiale. I contenuti generati dall'intelligenza artificiale sono famosi per la loro incoerenza nello stile di scrittura.

È vero che i modelli di intelligenza artificiale sono bravissimi a imitare il linguaggio umano. Ma non hanno la capacità di essere coerenti con i diversi stili di scrittura.

Ecco come si presentano di solito le incoerenze nello stile di scrittura con l'IA:

- Il tono passa rapidamente da formale a informale o da professionale a eccessivamente casual all'interno dello stesso contenuto.

- I lavori scritti dall'AI non riescono a fornire un flusso coerente nella scrittura, apparendo piuttosto sfalsati.

- La leggibilità è difficile perché ci sono troppe (o poche) prospettive.

Essere consapevoli delle incongruenze è importante per essere sicuri che il contenuto che stai leggendo sia credibile o meno.

5. Modelli di errore

Sbagliare è umano (e macchina). Anche i robot più intelligenti che abbiamo oggi commettono errori.

I modelli di errore sono una bandiera rossa comune per i contenuti generati dall'intelligenza artificiale, perché il modello stesso dell'intelligenza artificiale non funziona sempre correttamente o come previsto e l'organizzazione non effettua un controllo di qualità per verificare il testo e le informazioni fornite dallo strumento.

In breve, l'intelligenza artificiale è stata utilizzata per automatizzare il processo di generazione dei contenuti e, sebbene non sia un male, può andare male se non viene controllata.

Gli errori possono andare da quelli grammaticali a quelli di ortografia, da affermazioni contraddittorie a idee che non hanno molto senso logico.

Perché succede? L'intelligenza artificiale è solo un software con algoritmi complessi, il che rende possibili bug e problemi.

Anche la qualità dei dati utilizzati per addestrare i modelli di intelligenza artificiale può influenzare le prestazioni dello strumento.

6. Verifica dei fatti o dei dati personali

Un'altra cosa che l'IA non fa bene è la verifica delle informazioni che fornisce. Le informazioni errate fornite dall'IA sono una preoccupazione per oltre 75% dei consumatori.

L'incapacità dell'intelligenza artificiale di verificare fatti o dettagli personali può essere pericolosa. La disinformazione, in generale, può portare a fraintendimenti e può persino danneggiare individui e organizzazioni.

Ecco alcuni modi per evitare di essere male informati dall'intelligenza artificiale:

- Noi esseri umani siamo ottimi controllori incrociati, quindi verifica sempre le fonti fornite nei contenuti che leggi.

- Esercita un po' di spirito critico ed evita di credere a tutto quello che ti capita a prima vista.

- Soprattutto quando si tratta di contenuti ad alto rischio, assicurati che ci sia una supervisione umana per verificare che i contenuti siano accurati.

- Prenditi il tempo necessario per imparare le complessità dell'IA e comprenderne le capacità e i limiti.

L'intelligenza artificiale ha difficoltà a conoscere dati precisi perché si basa solo sulle informazioni che le vengono fornite. Ciò significa che qualsiasi nuova informazione non è affatto disponibile.

Inoltre, l'intelligenza artificiale non effettua controlli incrociati su più fonti e non è in grado di convalidare l'autenticità delle informazioni come fanno gli esseri umani.

Rilevate i contenuti generati dall'intelligenza artificiale e umanizzateli senza sforzo: iniziate da qui.

Conclusione

Grazie a questi indicatori, puoi essere più sicuro dei contenuti che leggi.

L'intelligenza artificiale è destinata a migliorare, quindi è importante tenere d'occhio come verificare se qualcosa è stato scritto da un chatbot, perché le regole cambieranno e dovremo adattarci.

Consumiamo così tanti contenuti online che può sembrare faticoso essere così attenti a tutto ciò che vediamo. Per semplificare il processo, fatti affiancare da Undetectable AI.

AI non rilevabile rende il rilevamento dell'IA facile ed efficiente e possiamo anche migliorare la leggibilità dei contenuti generati con il nostro AI humanizer.

In questo modo potrai essere a tuo agio con i contenuti che tu stesso produci. Due strumenti su un'unica piattaforma.

Mentre abbracciamo i vantaggi della tecnologia AI, diamo priorità al suo uso etico e combattiamo la disinformazione per mantenere l'integrità della comunicazione.