As batalhas judiciais de direitos autorais de IA estão se intensificando em 2025, remodelando a forma como a lei de direitos autorais interage com as tecnologias de IA generativas.

No centro está The New York Timescontra a OpenAI e a Microsoft, alegando uso não autorizado de seus artigos para treinar modelos avançados como o ChatGPT.

Ao mesmo tempo, uma onda de ações judiciais consolidadas de autores de best-sellers, editoras e empresas de mídia está desafiando a legalidade central das práticas de treinamento de IA.

Os resultados desses casos de alto risco podem redefinir o futuro da IA, do jornalismo e dos setores criativos em todo o mundo.

O que isso significa para o futuro da IA, da propriedade de conteúdo e da responsabilidade legal?

Aqui, detalhamos os principais desenvolvimentos, os principais participantes envolvidos e o que os criadores, as empresas e os tecnólogos precisam entender para seguir em frente.

Principais conclusões

- O processo do New York Times contra a OpenAI e a Microsoft está avançando no tribunal, com implicações importantes para a lei de direitos autorais, uso justo e práticas de treinamento de IA.

- Autores como George R.R. Martin e John Grisham fazem parte de uma ação coletiva consolidada, alegando que seus livros foram usados sem permissão para treinar grandes modelos de linguagem.

- Os tribunais estão examinando o uso de conteúdo protegido por direitos autorais pela IA, especialmente quando os metadados de direitos autorais (CMI) são removidos ou as obras são extraídas em massa sem consentimento.

- A OpenAI recebeu ordens para preservar os dados de bate-papo dos usuários, levantando importantes questões de privacidade e conformidade legal que podem influenciar as futuras políticas da plataforma.

- Ferramentas de IA indetectáveis, como o AI Humanizer e o AI SEO Content Writer, oferecem aos criadores um caminho seguro e legal para aproveitar a IA, evitando riscos de direitos autorais e de originalidade.

O NYT contra a OpenAI e a Microsoft: Sinais da sala do tribunal

Jornada jurídica e principais decisões (2025)

O caso do New York Timesiniciada em dezembro de 2023, continua sendo uma das mais importantes.

Em março de 2025, o juiz Sidney Stein recusou-se a rejeitar a ação, permitindo que a maioria das reivindicações de direitos autorais e DMCA prosseguisse - excluindo algumas reivindicações periféricas, como certos argumentos de concorrência desleal.

Em julho, as partes foram consolidadas com ações judiciais relacionadas movidas por autores como John Grisham e Jonathan Franzen, encaminhadas para o Distrito Sul de Nova York para um tratamento simplificado

A privacidade encontra o litígio: Preservação do bate-papo do usuário

Um ponto crítico de privacidade surgiu quando a OpenAI ordenado pelo tribunal para preservar indefinidamente os bate-papos dos usuários - mesmo os excluídos - para descoberta.

A OpenAI, liderada por Sam Altman, se opôs fortemente, citando a confiança do usuário e as normas de proteção de dados, e apresentou um recurso.

Disputas de descoberta e acesso a dados

O Times solicitou acesso a milhões de registros do ChatGPT, mas a OpenAI ofereceu um compromisso de apenas 20 milhões de bate-papos, enquanto o Times insistiu em até 120 milhões.

Implicações da DMCA: Informações sobre gerenciamento de direitos autorais (CMI)

Os autores da ação argumentam que a OpenAI retirou os metadados de direitos autorais do CMI dos artigos baixados antes de treinar seus modelos.

Casos como Raw Story v. OpenAI e outros sugerem que a DMCA As reivindicações podem sobreviver se os autores demonstrarem a remoção deliberada da CMI

O que isso significa para a IA, os criadores e o futuro do conteúdo

Uso justo sob análise: Os tribunais não estão mais deferindo amplamente o uso justo - como os dados foram obtidos, se a CMI foi removida e se o uso é realmente transformador estão todos sob exame jurídico microscópico

Consolidação Agiliza o litígio: Ao agregar mais de 12 ações judiciais relacionadas sob a responsabilidade do juiz Stein em Nova York, os casos podem ser coordenados de forma mais eficiente - potencialmente levando a um júri de referência que pode influenciar disputas semelhantes

Impactos nos modelos de negócios de IA: As empresas de IA podem se voltar cada vez mais para licenciamento de conteúdoA empresa está se preparando para enfrentar a crise, com a necessidade de um sistema de filtragem de dados mais rigoroso e maior transparência, especialmente à luz das ações judiciais de alto nível e da reação do público.

Aumento das pressões políticas e regulatórias: Com o Congresso e os editores pressionando por transparência, e casos como os que envolvem a ANI na Índia e a mídia no Canadá se desenvolvendo separadamente, as proteções regulatórias globais estão se tornando mais rígidas em relação ao treinamento de IA e ao uso de conteúdo.

Olhando para o futuro: O futuro da IA e a lei de direitos autorais

Com o aumento das ações judiciais em 2025, uma coisa é certa: o futuro da IA generativa será moldado por precedentes legais.

Os legisladores estão avaliando novas regulamentações, como a TRAIN Act, para impor transparência e licenciamento para dados de treinamento de IA.

Enquanto isso, as empresas de IA estão começando a se voltar para o conteúdo licenciado e o uso ético dos dados.

Ferramentas como o AI Humanizer e o AI SEO Content Writer oferecem um caminho mais seguro para o futuro, ajudando os usuários a criar conteúdo compatível e de alta qualidade sem correr o risco de violações de direitos autorais.

Globalmente, outros países estão seguindo o exemplo, sinalizando uma nova era em que o desenvolvimento da IA deve respeitar os direitos dos criadores humanos.

Os próximos anos provavelmente definirão se a IA prosperará como uma ferramenta de colaboração ou se enfrentará restrições legais mais rígidas.

Como a IA indetectável pode ajudar os criadores e as marcas a navegar nesse terreno

À medida que o cenário de direitos autorais e IA evolui, a Undetectable AI equipa os criadores com ferramentas que se alinham à segurança jurídica e à originalidade:

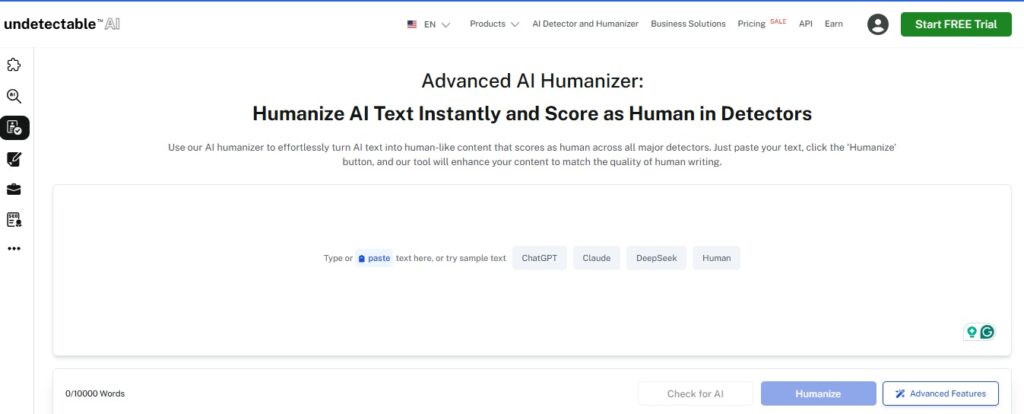

- Humanizador de IA - Garante que o conteúdo gerado por IA seja contextualmente refinado e nitidamente humano, ajudando a evitar o excesso de confiança nos resultados da IA, o que poderia gerar preocupações com infrações.

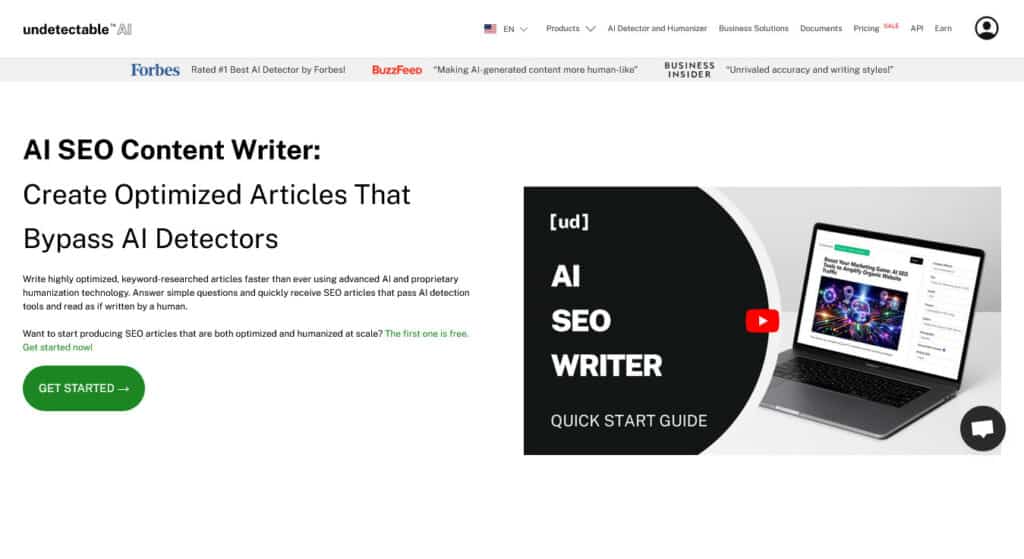

- Redator de conteúdo de SEO para IA - Gera conteúdo otimizado e original com base em dados licenciados ou seguros, apoiando uma narrativa atraente e protegida contra reivindicações de direitos autorais.

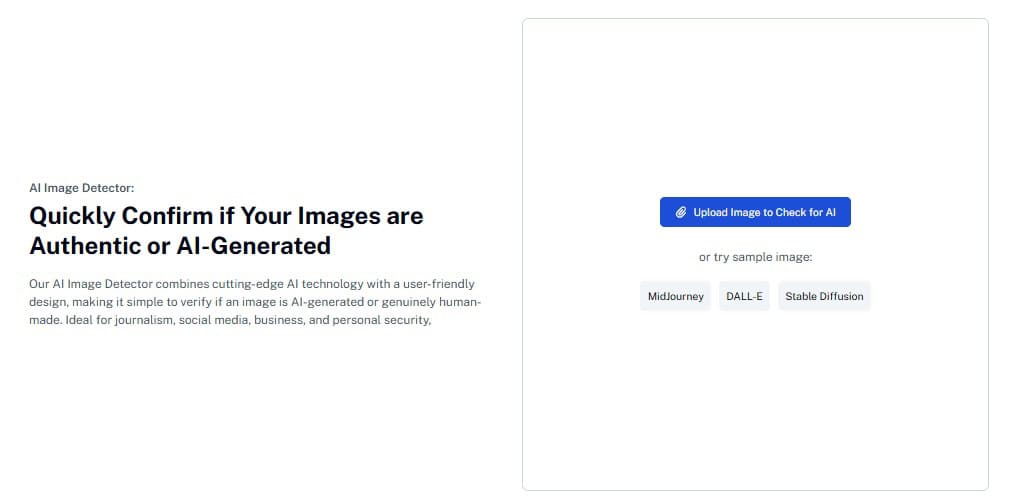

- Detector de imagens AI - Verifica a detectabilidade dos visuais gerados por IA, garantindo a transparência e a adesão a padrões éticos e legais.

- Insights internos e recursos de blog - Explore aprofundamentos relacionados, como "Como o treinamento em IA deve evoluir após NYT vs OpenAI" ou "Fair Use vs Fair Theft: Navegando pelo conteúdo de IA" para se manter informado e em conformidade.

Como o detector de imagens com IA do TruthScan apoia a integridade dos direitos autorais

Em uma época em que os recursos visuais gerados por IA estão inundando a Internet, manter a autenticidade da imagem é tão importante quanto proteger o conteúdo escrito.

Detector de imagens com IA do TruthScan ajuda os criadores, as equipes de mídia e os profissionais da área jurídica a verificar se uma imagem foi gerada, alterada ou extraída sem autorização.

Ele examina dados de pixel, metadados e padrões geradores ocultos para sinalizar visuais sintéticos ou manipulações não autorizadas.

Para editoras e marcas, isso garante que cada imagem usada, seja para marketing, jornalismo ou design de produto, atenda aos padrões éticos e de direitos autorais.

Juntos, a Undetectable AI e o TruthScan oferecem aos criadores e às marcas as ferramentas para proteger seu trabalho e manter a integridade no mundo digital em rápida mudança de hoje.

Detecte padrões de IA e humanize sua escrita em segundos - use o widget abaixo.

Perguntas frequentes

Ainda é seguro treinar IA em conteúdo da Web em escala?

Não sem cautela. Você deve considerar o licenciamento, a retenção de CMI e se o uso é realmente transformador.

Como os tribunais têm enfatizado, o uso justo não supera a remoção intencional da proteção contra cópia ou o uso em massa de obras protegidas por direitos autorais.

Essas ações judiciais abrirão precedentes legais?

Possivelmente - mas com ressalvas. O acordo da Anthropic evita uma decisão. O caso do NYT pode ter um peso substancial, mas os resultados podem variar de acordo com a jurisdição, as práticas de dados e a prova de danos.

Nunca mais se preocupe com a detecção de seus textos pela IA. Undetectable AI Pode lhe ajudar:

- Faça sua escrita assistida por IA aparecer semelhante ao humano.

- Bypass todas as principais ferramentas de detecção de IA com apenas um clique.

- Uso IA com segurança e com confiança na escola e no trabalho.

Como os criadores podem proteger seu trabalho?

Aproveite ferramentas como a Undetectable AI para gerar conteúdo com aparência humana e monitorar possíveis infrações. Registre os direitos autorais quando necessário e considere as opções de exclusão ou licenciamento.

Qual é a função da privacidade nesses casos?

Enorme. A OpenAI está recorrendo de ordens que exigem retenção indefinida de dados, citando normas de privacidade, GDPR e confiança do usuário. Isso sugere que casos futuros poderão equilibrar a lei de PI com proteções de privacidade.

A legislação está chegando?

A pressão está aumentando - de autores, editores e legisladores - para legislar sobre transparência de IA e remuneração justa. Mas, até o momento, novas leis significativas não foram aprovadas.

Conclusão

O conflito entre IA e direitos autorais não é mais hipotético - está aqui, ao vivo nos tribunais.

Os resultados dos processos do NYT e dos autores consolidados, juntamente com o acordo da Anthropic, estão redefinindo a forma como a IA geradora deve adquirir e respeitar o conteúdo protegido por direitos autorais.

Para criadores, editores e desenvolvedores de IA, entender as regras em evolução - e escolher ferramentas que as respeitem - agora é essencial.

É aí que entra a IA indetectável.

Seja você um escritor, educador, empresa ou equipe jurídica, ferramentas como o AI Humanizer, o AI SEO Content Writer e o AI Image Detector permitem que você crie conteúdo compatível, com som humano e protegido por direitos autorais, pronto para 2025 e além.

Fique protegido. Mantenha-se original. Explore Indetectávelle IA hoje e construir com confiança na era da IA ética e transparente.